> 发表期刊:Nature Machine Intelligence(自然·机器智能)

> 核心价值:大模型Agent原生接入机器人操作系统ROS,全套框架开源开放,不用复杂编程,普通人也能操控机器人完成复杂任务,重新定义具身智能的底层基础设施,让机器人真正“听得懂、会思考、能行动”。

一、具身智能迎来里程碑:LLM 与 ROS 彻底打通,机器人告别“笨手笨脚”

用过家用机器人、工业巡检机器人的朋友应该都有体会:传统机器人更像是“被设定好程序的木偶”——只能执行提前编好的固定动作,稍微换个场景、换句指令,就会“罢工”或“出错”。比如你让它“把客厅茶几上的红色水杯拿到卧室”,它能完成,但如果你说“把茶几上的水杯拿过来,顺便把沙发上的书摆好”,它就会陷入“混乱”,要么只做一件事,要么直接卡住。

这背后的核心问题,其实是“大脑”和“手脚”的脱节:机器人的“手脚”(硬件执行部分)靠ROS(机器人操作系统)驱动,负责接收指令、调动硬件;但它的“大脑”(决策部分)却很薄弱,无法理解自然语言,更不会自主拆解复杂任务。而近期发表在Nature Machine Intelligence上的一项研究,恰恰解决了这个痛点——研究团队直接将LLM Agent(大语言模型智能体)架构嵌入ROS,打造出一套通用、可落地、完全开源的具身智能框架。

这不是简单的“功能叠加”,而是一次革命性的打通:从此以后,机器人的“大脑”(LLM)能真正指挥“手脚”(ROS),不仅能听懂人类的自然语言,还能自主思考、拆解复杂任务,甚至能根据环境变化实时调整动作,真正具备了开放世界下的推理与执行能力。

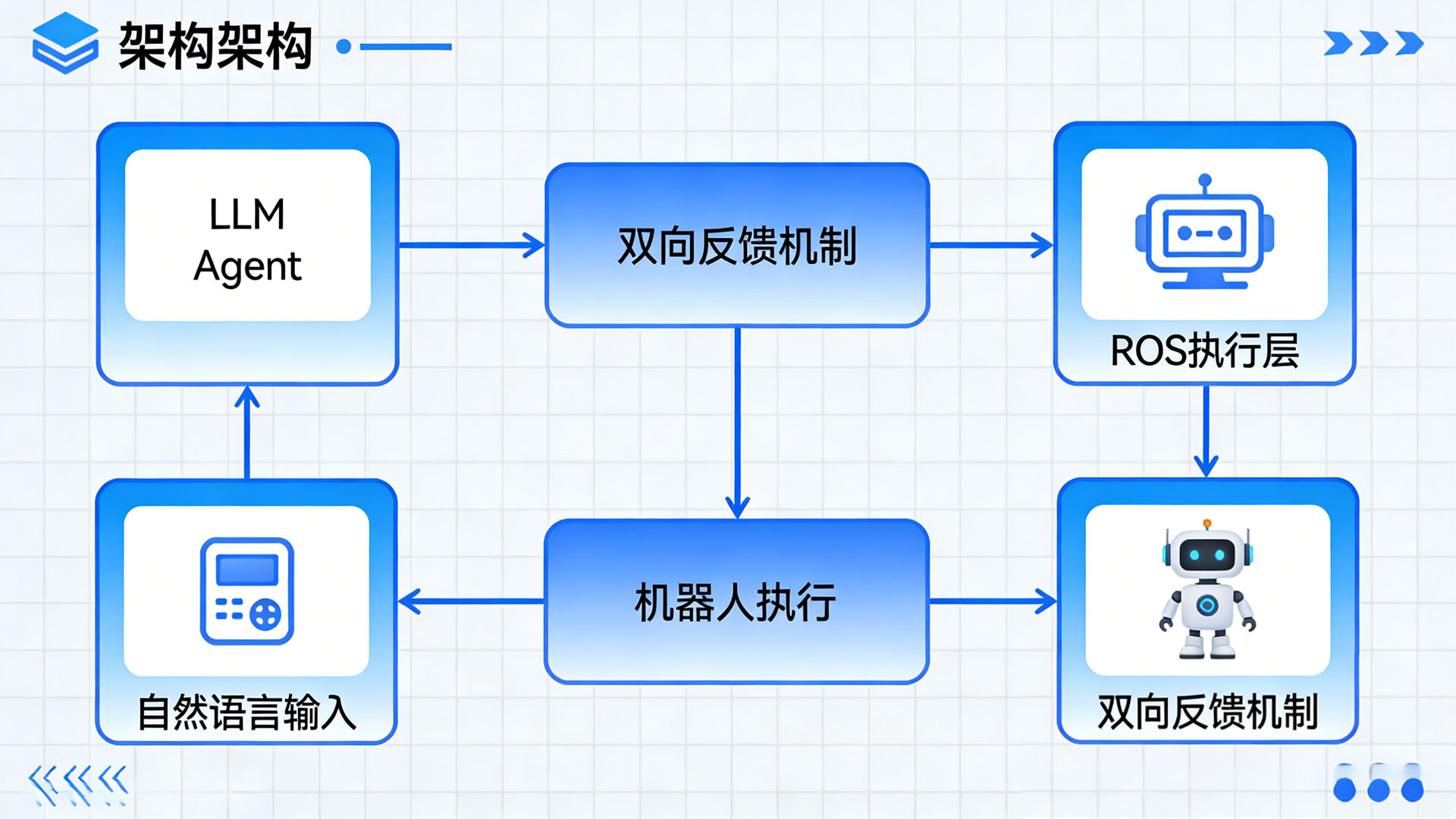

二、框架核心架构:LLM 做“聪明大脑”,ROS 做“灵活手脚”

这套框架的逻辑其实很容易理解,本质就是给机器人装了一个“会思考的大脑”,再让这个大脑直接掌控“手脚”的行动,形成“思考-执行-反馈-修正”的完整闭环,不用再通过中间环节中转指令。

核心工作流程(普通人也能看懂)

核心工作流程(普通人也能看懂)

1. 你下达自然语言指令:比如“帮我把阳台的衣服收进来叠好,再把叠好的衣服放进衣柜上层”;

2. LLM Agent(大脑)开始工作:先理解你的真实意图,再把这个复杂任务拆解成一个个简单的“原子动作”——比如“走到阳台→识别衣服→拿起衣服→折叠衣服→走到衣柜→打开衣柜门→放入衣服”;

3. 指令转化与执行:LLM会自动把这些“原子动作”,转化成ROS能直接识别的节点、话题和动作指令,调动机器人的导航、抓取、视觉识别等模块,让硬件开始执行;

4. 实时反馈与修正:机器人执行过程中,身上的传感器会实时回传环境状态——比如“衣服没叠整齐”“衣柜门没打开”,LLM会根据这些反馈,重新调整指令,直到任务完成。

这里有个关键亮点:LLM和ROS是“原生接入”,不是简单的“拼接”,这就避免了中间指令转化的延迟和误差,让机器人的动作更流畅、决策更迅速。而且它支持GPT-4、Llama 2、Qwen等主流开源和闭源大模型,开发者可以根据自己的需求灵活选择。

三、关键能力:让机器人从“机械执行器”变成“自主决策者”

这套框架最让人惊喜的,不是它的技术有多高深,而是它真正解决了“机器人落地难、使用难”的问题,把复杂的技术封装起来,让普通人也能轻松用起来,核心能力主要有4点,每一点都很实用:

1. 自然语言零编程控制:不用掌握ROS开发、Python编程等专业知识,哪怕是老人、孩子,只要会说话,就能给机器人下达复杂指令。比如你对家用机器人说“晚上8点帮我煮一杯温水,放在床头”,它就能自主规划时间、找到水壶、煮水、放置,全程不用你插手。

2. 开放世界推理能力:这是最核心的突破。传统机器人只能在固定场景工作,比如工厂里的流水线机器人,只能重复固定动作;但这套框架让机器人能应对未知环境——比如在陌生的房间里,它能自主识别障碍物、规划路径,哪怕遇到突发情况(比如水杯被挡住),也能自己想办法绕开,而不是直接卡住。

3. 工具链自主调用:机器人能根据任务需求,自动调度身上的所有“工具”——比如需要拿东西时,调用抓取模块;需要移动时,调用导航模块;需要识别物体时,调用视觉识别模块。不用开发者手动配置,大大降低了开发和使用成本。

4. 端到端开源可复用:研究团队把全套代码、配置文件、示例工程都公开在了GitHub上,无论是高校做科研实验,还是中小企业开发机器人原型,都能直接下载、二次开发,不用从零开始搭建框架,节省大量时间和人力成本。

四、为什么这件事,会改写整个机器人行业?

四、为什么这件事,会改写整个机器人行业?

可能有朋友会问:市面上关于具身智能的研究那么多,为什么这篇Nature论文、这套开源框架,能被称为“行业里程碑”?其实答案很简单——它解决了行业最核心的“痛点”,而且做到了“顶刊背书+开源落地”,这在行业里是很少见的。

1. 补齐具身智能最关键的“软件基建”短板

一直以来,具身智能的发展都受限于“软件架构”:大模型擅长思考、推理、理解语言,但不会驱动硬件;ROS擅长驱动硬件、调度模块,但不会思考、不会理解自然语言。很多研究要么只做LLM的推理优化,要么只做ROS的功能升级,两者脱节,导致很多技术只能停留在实验室,无法落地。

而这套LLM+ROS框架,直接打通了这两个核心环节,形成了“认知-规划-执行-反馈”的完整闭环,相当于给具身智能搭建了一套“标准地基”。以后不管是做人形机器人、家用服务机器人,还是工业机器人,都能在这个地基上快速搭建,不用再重复造轮子。

2. Nature顶刊背书+完整开源,直接拉高行业基础门槛

Nature Machine Intelligence作为顶刊,它的认可,意味着这套框架的技术可行性和创新性得到了全球学术界的认可;而“完整开源”,则让这套框架能快速普及——全球的高校、实验室、机器人公司,都能基于这套框架协作创新,中小企业也能低成本接入,不用再投入大量资金研发底层架构。

可以预见,用不了多久,这套框架就会成为全球具身智能研究和开发的“标准参考架构”,直接拉高整个行业的基础能力上限,让更多机器人产品快速落地。

3. 加速人形机器人、服务机器人的商业化落地

在此之前,人形机器人、家用服务机器人之所以难以普及,核心原因就是“开发成本高、使用门槛高”——一款家用机器人,需要团队花费数月甚至数年,开发专属的控制程序,而且普通人还不会操作。

在此之前,人形机器人、家用服务机器人之所以难以普及,核心原因就是“开发成本高、使用门槛高”——一款家用机器人,需要团队花费数月甚至数年,开发专属的控制程序,而且普通人还不会操作。而这套框架,正好解决了这个问题:开发者可以直接基于框架,快速开发出具备自然交互、自主决策能力的机器人;普通人不用学习编程,只要说话就能操控。这会大大加速家用服务、工业巡检、仓储物流、医疗辅助等场景的机器人落地,比如以后家里的老人,不用麻烦子女,就能让机器人帮忙做饭、取物、打扫卫生;工厂里的工人,不用手动操作,就能让机器人完成复杂的装配、巡检任务。

五、开发者与研究机构:直接上手,零门槛接入

对于科研人员、机器人开发者来说,这套框架最友好的地方,就是“零门槛接入”——它兼容ROS1(Noetic、Melodic版本)和ROS2(Humble版本),支持主流的开源大模型(Llama 2、Qwen、Mistral等)和闭源大模型(GPT-4、Claude等),而且提供了完整的部署文档、示例场景和调试工具,哪怕是刚接触ROS开发的新手,也能快速搭建起自己的具身智能系统。

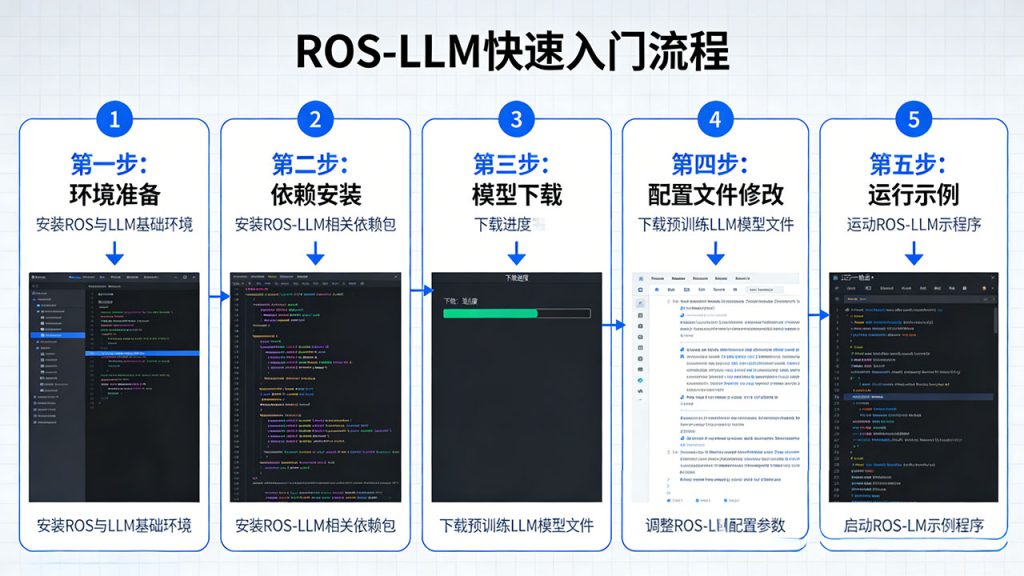

简单说一下快速上手指南(不用记复杂命令,跟着文档走就行):

1. 环境准备:先在电脑上安装对应的ROS版本(新手推荐ROS2 Humble,兼容性更好);

2. 下载框架:通过Git命令克隆开源仓库(git clone https://github.com/huawei-noah/ROS-LLM.git),全程自动下载,不用手动配置依赖;

3. 配置LLM:根据自己的需求,接入OpenAI API(闭源),或者本地部署Llama 2等开源模型,文档里有详细的配置步骤;

4. 运行示例:启动演示程序,输入自然语言指令(比如“拿起桌上的笔”),就能看到机器人自主执行任务,还能实时查看LLM的推理过程和ROS的指令输出。

六、结语:机器人的“语言革命”与“推理觉醒”,离我们越来越近

六、结语:机器人的“语言革命”与“推理觉醒”,离我们越来越近

其实这些年,我们一直在期待“能听懂人话、能自主做事”的机器人,但大多停留在科幻电影里。而这套LLM+ROS开源框架的发表与落地,终于让这个期待变成了现实——它没有复杂的技术噱头,而是实实在在地解决了机器人“不会思考、不会沟通”的核心问题,让机器人从“机械工具”真正变成了“能自主决策的助手”。

正如论文通讯作者Jun Wang所说:“这一框架让机器人首次真正具备了在开放世界中理解、推理和行动的能力,为通用具身智能奠定了坚实基础。” 对于我们普通人来说,未来不用再羡慕科幻电影里的机器人管家;对于开发者来说,不用再为底层架构头疼,可以把更多精力放在场景创新上。

随着开源社区的不断优化、技术的持续迭代,相信用不了多久,具备开放世界推理能力的机器人,就会走进我们的家庭、工厂、医院,成为我们生活和工作中的好帮手。而现在,正是加入这场机器人“语言革命”的最好时机。