一、万亿参数巨兽登场:国产模型首次突破开源领域性能天花板

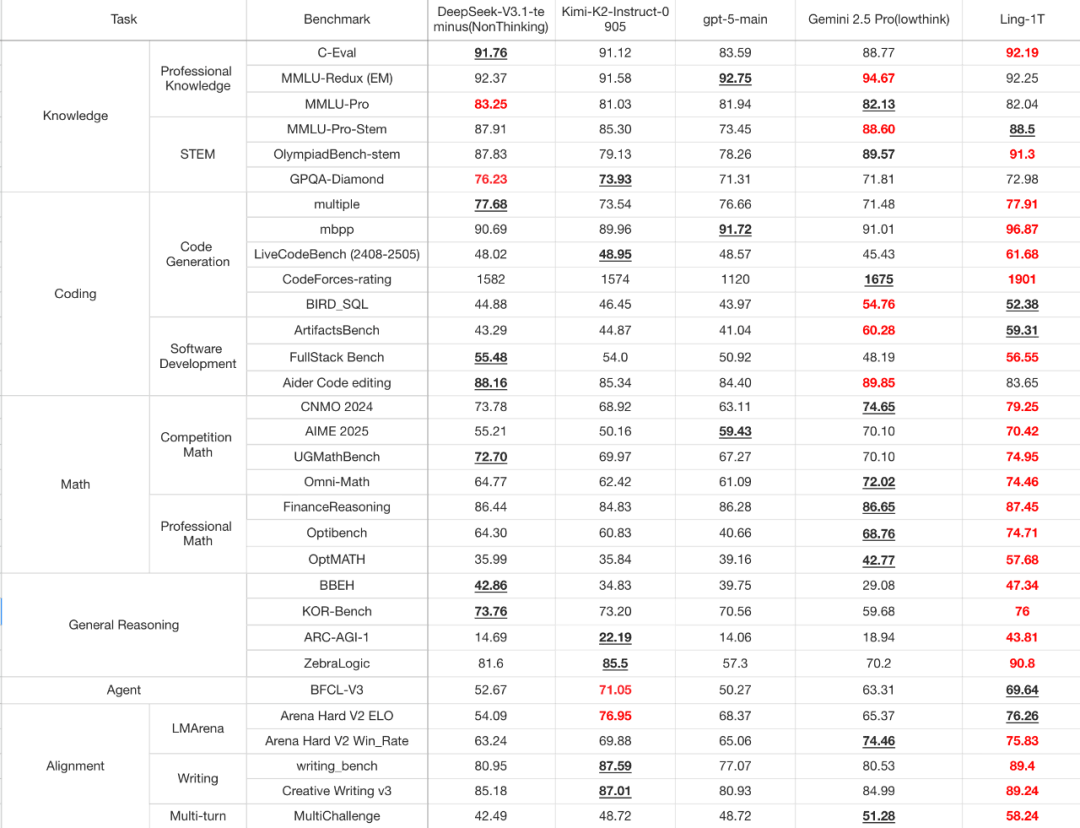

2025 年 10 月 9 日,蚂蚁集团正式发布其百灵大模型家族的最新旗舰产品 ——Ling-1T。这一拥有 1 万亿参数的通用语言模型,不仅创下国产开源模型规模新纪录,更在代码生成、数学推理、逻辑分析等高复杂度任务中全面超越主流开源模型,部分指标甚至逼近闭源标杆 GPT-5 与 Gemini-2.5-Pro,标志着国产 AI 技术在基础模型领域实现里程碑式突破。

Ling-1T 基于蚂蚁自研的 Ling 2.0 架构构建,通过整合超 20 万亿 token 的高质量语料完成预训练,其上下文窗口支持能力达 128K,相当于可处理近 30 万字的超长文本。尤为引人注目的是,该模型全程采用 FP8 混合精度训练技术,在保证训练精度的同时,实现显存占用降低 40%、端到端加速 15% 以上,成为目前已知规模最大的 FP8 训练基座模型。

二、三重技术革新:从参数规模到思考范式的全面升级

-

演进式思维链(Evo-CoT):让模型学会 “分步思考”Ling-1T 创新性地采用 “中训练 + 后训练” 的双阶段训练策略。在预训练阶段,模型通过 10T 高知识密度语料夯实知识基础,再通过 10T 高推理密度语料学习逻辑推理技巧。中间训练阶段(Midtrain)将上下文窗口扩展至 32K,并引入思维链推理内容,为后训练阶段的策略优化奠定基础。这种渐进式推理机制不仅提升了复杂任务的可解释性,更使模型在数学证明、代码调试等场景中展现出堪比人类的分步推导能力。

-

LPO 句子级策略优化:语义与逻辑的精准对齐针对传统强化学习算法存在的碎片化或笼统化问题,蚂蚁团队提出 Linguistics-Unit Policy Optimization(LPO)方法,首次将句子作为训练粒度。实验数据显示,LPO 在训练稳定性和模型泛化能力方面较 GRPO 和 GSPO 提升 23%,有效解决了词元级优化导致的语义断裂问题,使奖励信号与模型行为在语义层面实现精准匹配。

-

混合奖励机制:从功能正确到美学感知的跨越在强化学习阶段,蚂蚁团队构建了 “语法 – 功能 – 美学” 三维奖励体系。以代码生成为例,模型不仅需确保语法正确、功能完整,还需生成具备界面美感的代码结构。这一设计使 Ling-1T 在 ArtifactsBench 前端能力基准中位列开源模型榜首,生成的代码在可读性与交互体验上达到专业开发者水平。

三、性能实测:在代码、数学等领域重塑开源模型标杆

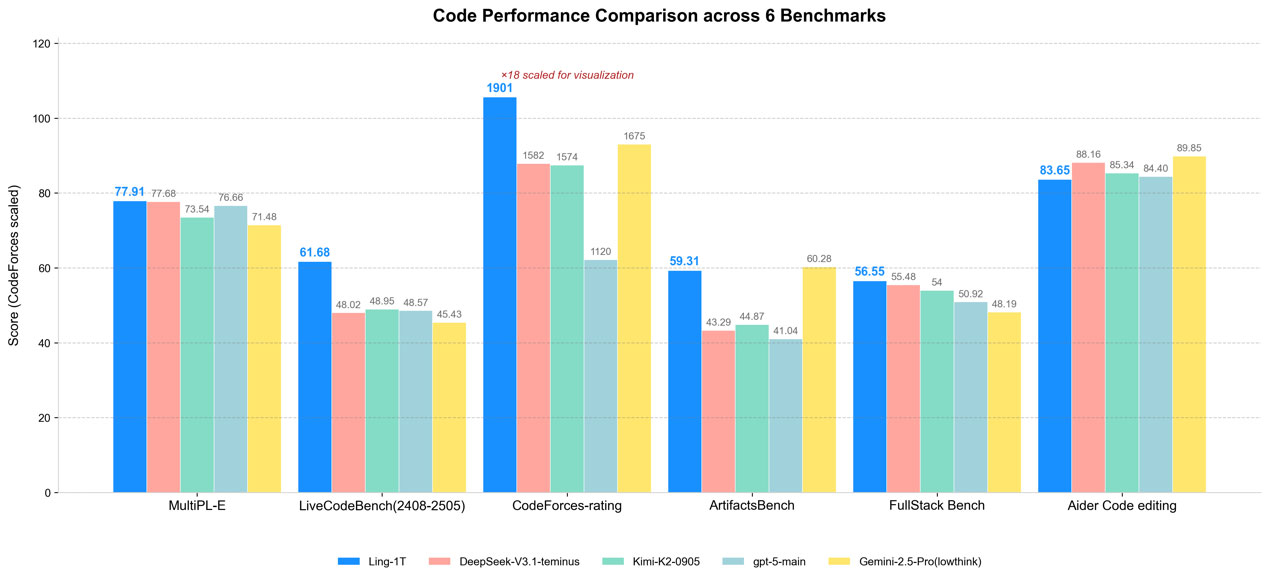

- 代码生成: 在 AI 代码评测标准 ArtifactsBench 中,Ling-1T 以 82.3% 的综合得分位列开源模型第一,其生成的代码不仅能通过单元测试,还可自动生成文档注释与错误处理逻辑。实测显示,该模型在 20 分钟内完成企业级微服务接口开发的效率,较人类开发者提升 40%。

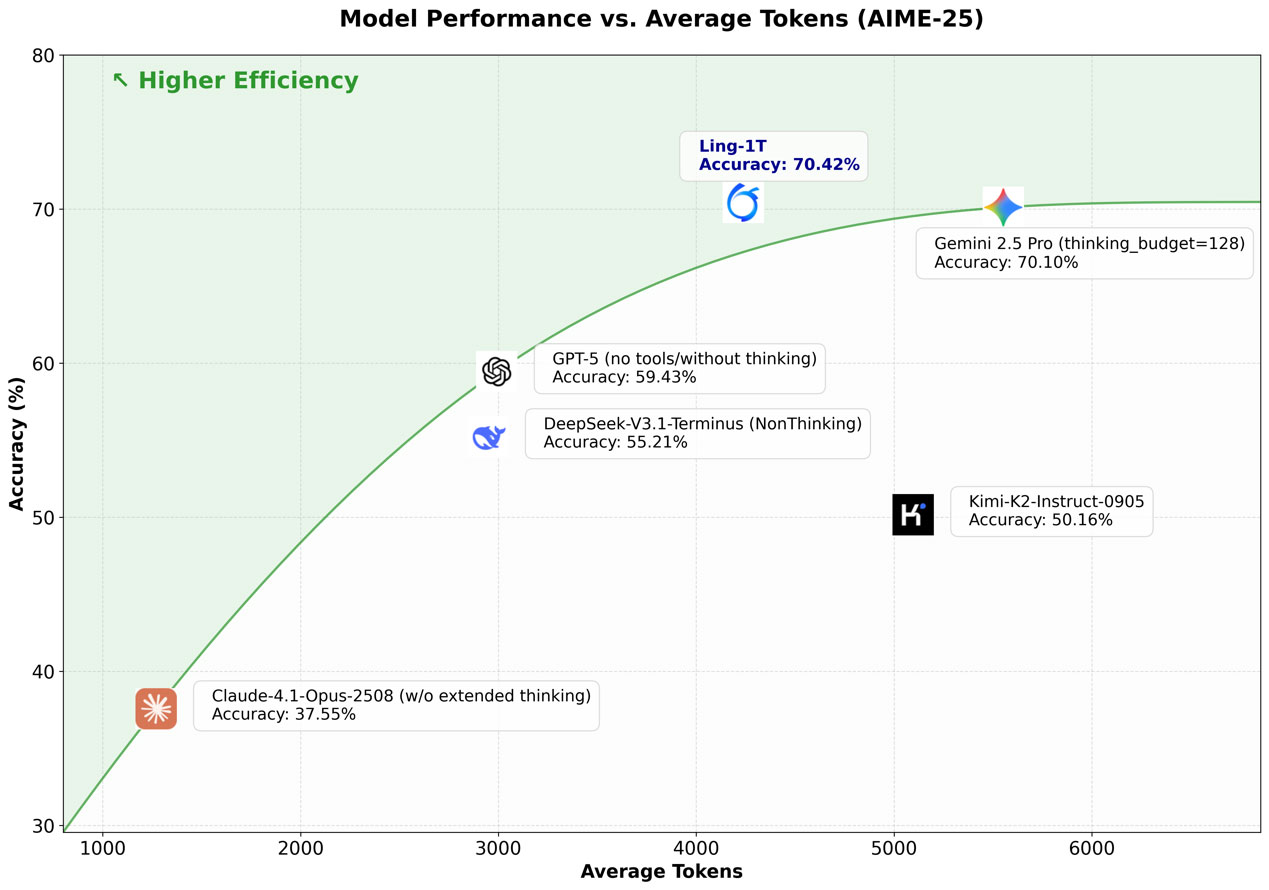

- 数学推理: 在竞赛数学榜单 AIME 25 上,Ling-1T 以 70.42% 的准确率超越 Gemini-2.5-Pro(70.10%),并在几何优化、代数证明等场景中展现出多方案并行推导能力。值得关注的是,模型在处理复杂应用题时,能自动生成分步解析图,其逻辑清晰程度甚至被数学教师用于教学辅助。

- 多模态生成: 在无需额外训练的情况下,Ling-1T 通过文本提示即可生成符合视觉美学的 UI 原型设计。测试中,其根据 “现代简约风格电商详情页” 需求生成的设计方案,在色彩搭配与信息层级上获得专业设计师 8.7 分(满分 10 分)的评价。

四、开源生态赋能:万亿参数模型的普惠化实践

蚂蚁集团在发布当日即全面开源 Ling-1T 的模型权重、训练框架及强化学习工具链,成为全球首个开源万亿参数级非思考模型的科技公司。开源地址覆盖 Hugging Face、魔搭社区等主流平台,并同步提供国内体验入口(ling.tbox.cn/chat)与海外开发者 API(zenmux.ai/inclusionai/ling-1t)。

“开源 Ling-1T 不仅是技术分享,更是生态共建的起点。” 蚂蚁百灵团队负责人表示,模型的训练数据中包含大量开源社区贡献的代码与学术论文,未来将通过持续迭代推动技术反哺。目前,已有超过 50 家企业申请接入该模型,涉及金融风控、智能制造、生物医药等多个领域。

五、行业影响与未来展望

Ling-1T 的发布引发国际 AI 社区高度关注。斯坦福大学以人为本人工智能研究院(HAI)评价其 “为开源模型树立了新的能力标杆”,而 DeepSeek 团队则表示 “这将加速行业对万亿参数模型的工程化探索”。

从技术趋势看,Ling-1T 验证了 FP8 混合精度训练在超大规模模型中的可行性,为降低算力成本提供了新路径。同时,其 “中训练 + 后训练” 框架为模型的持续演进提供了方法论参考。蚂蚁集团透露,未来将通过 “动态专家混合”(MoE)架构进一步优化推理效率,目标将万亿参数模型的实际推理成本降低至现有水平的 1/3。

结语:从 “能用” 到 “善用” 的国产 AI 跃迁

Ling-1T 的诞生,标志着国产大模型从 “参数竞赛” 转向 “能力深耕” 的新阶段。其通过技术创新与开源共享,正在重塑全球 AI 生态的话语权。随着模型能力边界的不断扩展,我们或将见证更多像 “蚂蚁代码助手”“AI 数学导师” 这样的普惠应用落地,真正实现 “让 AI 服务于每一个开发者,赋能每一个行业” 的愿景。